Кибератаки на нейросети: как хакеры обманывают ИИ в 2025 году и что с этим делать российским компаниям

15-07-2025

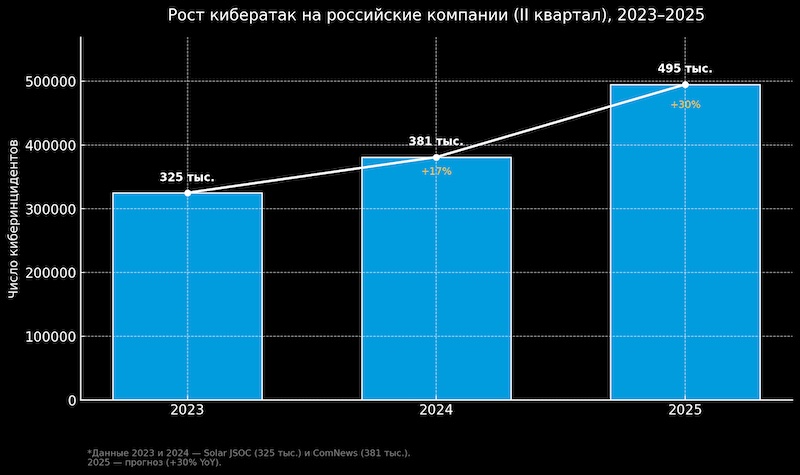

В 2025 году искусственный интеллект (ИИ) стал неотъемлемой частью защиты в кибербезопасности. Антивирусы Kaspersky, системы мониторинга Сбербанка, чат‑боты Ozon — все они используют нейросети, чтобы оперативно выявлять угрозы и защищать данные. Но есть и обратная сторона: хакеры научились обманывать ИИ и использовать его слабости. Защитник может сам стать уязвимостью. По данным ComNews в прошлом году число кибератак в России выросло на 17 %, и в 2025 году нейросети стали новой целью. Представьте: ваш умный ИИ‑антивирус — как шахматный гроссмейстер, которого хакеры хитро заманивают в тщательно рассчитанную ловушку.

Что такое атаки на нейросети?

Нейросети — это алгоритмы машинного обучения, которые анализируют данные, выявляют угрозы или общаются с клиентами через чат‑боты. Хакеры нашли способ их обманывать, используя так называемые adversarial AI‑атаки. Это как дать студенту на экзамене шпаргалку с нарочно перепутанными формулами: он уверен, что всё правильно, иуверенно решает — но решает не то.

Три основных приёма:

- Data poisoning (отравление данных). В атаках подмешиваются фейковые записи в датасет, чтобы ИИ учится "игнорировать" пропускать вредоносные паттерны.

- Model evasion (обход модели). Небольшие изменения во входных данных позволяют обойти проверку, например скрыть незарегестрированного человека от системы распознавания лиц.

- Prompt injection. Хитрые запросы к генеративному ИИ вынуждая чат-бота раскрывать конфиденциальные данные или выполнять команды, которые выходят за рамки его задач.

Пример. В 2024 году хакеры атаковали корпоративный чат‑бот, задав ему вопросы, которые заставили выдать внутренние данные. В России такая угроза особенно актуальна, где Telegram‑боты (Ozon, Госуслуги и др.) используются повсеместно. Один уязвимый бот — и вы уже открыли ворота внутрь системы.

Картина угроз для России в 2025 году

- Рост кибератак. По данным ComNews в 2024 году зафиксировано 381 000 инцидентов; в 2025 прогнозируется ещё +30% направленных атак на ИИ.

- Регуляторные штрафы. Закон 152‑ФЗ грозит до 50 млн ₽ за утечку персональных данных.

- Дефицит кадров. По оценке НИУ ВШЭ России не хватает ~1 млн ИТ‑специалистов, включая экспертов по ИИ‑безопасности.

- Локальные особенности. Чат‑боты и ИИ‑аналитика в финтехе и ритейле часто внедряются без должного тестирования на устойчивость к adversarial AI-атакам. В результате - доступ к данным, манипуляции, подмена логики принятия решений.

Локальный пример. Мировой инцидент с ботом McHire в 2024г. показал, как слабая защита ИИ приводит к утечке данных. Похожие риски ожидают российские банки, ритейл и госсектор.

Реальные угрозы и кейсы

- Заражение данных в банке. Фейковые транзакции в обучении → антифрод теряет чувствительность к фроду.

- Обход ИИ‑антивируса. Модифицированный вредонос не детектится ИИ-движком Kaspersky или Positive Technologies.

- Манипуляция чат‑ботами. Хитро сформулированный запрос - и бот Ozon или ВТБ раскрывает конфиденциальные сведения клиента.

Реальный кейс: McHire (2024).У чат-бота McDonald's вытащили персональные данные кандидатов через уязвимость в логике запросов. Обошли фильтры, вытянули таблицы. Таких кейсов будет больше: по прогнозам, атаки на ИИ в России вырастут минимум на 30% в 2025 году. И не потому что ИИ слаб, а потому что его неправильно интегрируют и не защищают как полноценный компонент ИТ-инфраструктуры.

Как защититься: практические решения

| Для бизнеса | Для разработчиков | Для сотрудников |

|---|---|---|

|

|

|

Локальный акцент. Kaspersky и Group‑IB уже предлагают решения для защиты нейросетей от заражения данных и анализа уязвимостей.

Что ждёт Россию в 2025 году?

Генеративный ИИ повышает реалистичность дипфейков, фишинговых писем и поддельных голосовых команд. Минцифры разрабатывает стандарты, а объём российского рынка AI‑security уже оценивается в ≈12 млрд ₽ и растёт на 25 % в год. Партнёрство с университетами (МФТИ, НИУ ВШЭ) помогает закрыть кадровый разрыв, но выигрывают компании, инвестирующие в постоянное тестирование моделей.

Заключение: опередить хакеров

Нейросети — мощный инструмент, но без защиты легко становятся уязвимостью. Проверяйте модели, обучайте персонал и задействуйте отечественные решения от Kaspersky, Group‑IB, MTS AI. Чем раньше начнётся работа по устойчивости ИИ, тем меньше шансов у злоумышленников.